- Los expertos consideran que al igual que otros campos la IA debe seguir parámetros o pautas, donde además se respete la pericia del talento humano

La inteligencia artificial (IA) es una tecnología que invita a los científicos y profesionales de la salud a enfatizar en la necesidad de la regulación debido a los códigos de ética que debe cumplir el área médica.

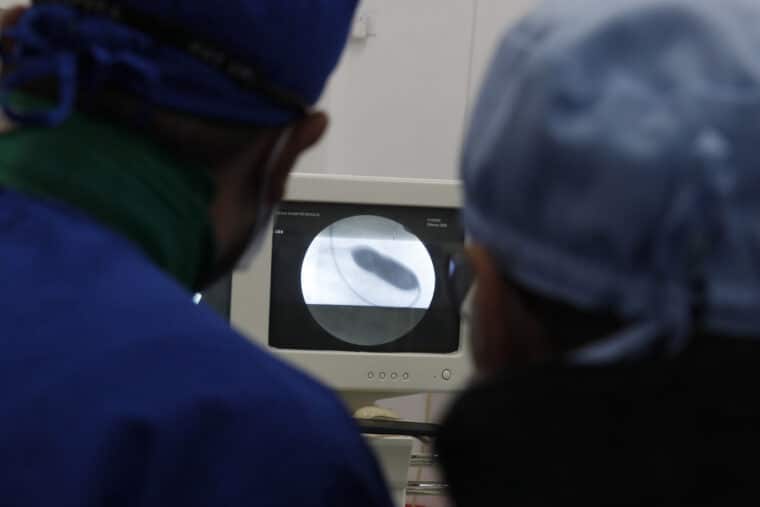

En particular, la IA está revolucionando la industria de la salud al proporcionar a los profesionales médicos mejores herramientas para diagnosticar enfermedades con mayor precisión.

De hecho, una de las empresas que está aprovechando los beneficios de IA es Quibim, que utiliza esa tecnología para transformar imágenes médicas en “predicciones procesables”.

Sin embargo, los modelos de lenguaje de IA pueden acceder a información en registros de salud digitales, proporcionar a los pacientes resúmenes de notas técnicas, o incluso engañar a los médicos y brindar respuestas que conduzcan a un plan de tratamiento o un diagnóstico incorrecto.

Si bien, los profesionales de la salud desean que la tecnología pueda ayudarlos a atender a los pacientes, por otro lado, varios investigadores no quieren dejar en manos de la IA la toma de decisiones éticas difíciles.

El camino hacia un modelo de regulación

A propósito de ello, en el año 2021, la agencia de Naciones Unidas para la Educación, la Ciencia y la Cultura (Unesco) presentó un documento que se llamó Recomendación sobre la Ética en la Inteligencia Artificial, el cual fue firmado por 193 países, aunque solo 24 lo están implementando formalmente.

Si bien el acuerdo es de carácter no vinculante, se ofrecen pautas de actuación en asuntos como la gobernanza de los datos, las tecnologías de espionaje masivo, el abuso de los sesgos cognitivos y el control de la neurotecnología. Asimismo, la pauta cuenta con la aprobación de la Comisión de la Unión Europea y el gobierno de Japón.

Gabriela Ramos, subdirectora general de la Unesco, es impulsora de una declaración internacional sobre ética algorítmica, y cree que si los medicamentos en todo el mundo deben cumplir con estándares de calidad antes de comercialización regional e internacional lo mismo debe aplicarse al área de la tecnología.

ChatGPT puede llegar a “fabricar hechos”

De acuerdo con Heather Mattie, profesora de salud pública de la Universidad de Harvard, que estudia el impacto de la IA en la atención médica, escribió que solicitó a la herramienta ChatGPT un resumen de cómo se ha utilizado el modelado de conexiones sociales para estudiar el VIH, un tema del cual es investigadora.

Sin embargo, la IA tocó temas fuera de su conocimiento, y la investigadora no pudo discernir si la información era fidedigna.

Mattie mostró su preocupación sobre cómo el ChatGPT trata el diagnóstico de enfermedades cardiovasculares y lesiones en cuidados intensivos, ya que a su juicio puede llegar a “fabricar hechos” o no deja muy claro la data de la información en la que se basa para emitir una respuesta.

Expansión del mercado

Desde 2022, el mercado global de IA se valoró en 119.780 millardos de dólares y se espera que se expanda con una tasa de crecimiento anual compuesta del 38,1 % entre 2023 y 2030.

La cuota de mercado de IA está dominada por el área de publicidad y medios, seguida por los sectores financiero y de salud.

El segmento de las imágenes médicas es el más grande en esta industria, y se prevé que gane una participación líder para 2030.

El peligro está en no aprovechar el potencial

Algunos expertos como la doctora Regina Barzilai creen que no todo es tan malo para la medicina alrededor de la IA.

Barzilai ha desarrollado algoritmos con los que mejorar el diagnóstico del cáncer con el uso de la herramienta, por lo que consideran que “el peligro está en no aprovechar el potencial de una tecnología”.

A diferencia de otros investigadores, cree que con la IA se puede mejorar la precisión del diagnóstico y hasta abaratarlo.

Para Barzilai, el peligro está en retrasar su aplicación a la medicina, porque hay mucha gente que padece las consecuencias de un cuidado médico insuficiente, bien sea por errores médicos o por los costos asociados a la sanidad en todo el mundo.

Algunos temores sobre el uso de la IA en medicina

En medicina, la IA podría indicar a los pacientes lo que dicen los manuales para una lesión o determinado padecimiento, pero si el médico hace caso omiso en base a su experiencia y experticia los resultados no serían más satisfactorios.

Estas son algunas consideraciones donde el capital humano podría ser irremplazable en la atención sanitaria:

-Ausencia de empatía: la tecnología no posee la capacidad de mostrar empatía por los pacientes, un aspecto importante de la atención médica

-La dependencia excesiva: la dependencia excesiva de la IA podría llevar a la pérdida de la habilidad de los médicos para tomar decisiones relacionadas al tratamiento de sus pacientes.

-El sesgo en los datos: si los datos en los que se basa la IA tienen sesgos podría conducir a diagnósticos erróneos

-La privacidad y seguridad de los datos: el volumen de datos médicos que necesita la herramienta para funcionar plantea preocupaciones de seguridad sobre los registros médicos de los pacientes.