- Los expertos en ciberseguridad recomiendan tener en cuenta una serie de detalles para determinar la autenticidad del material audiovisual

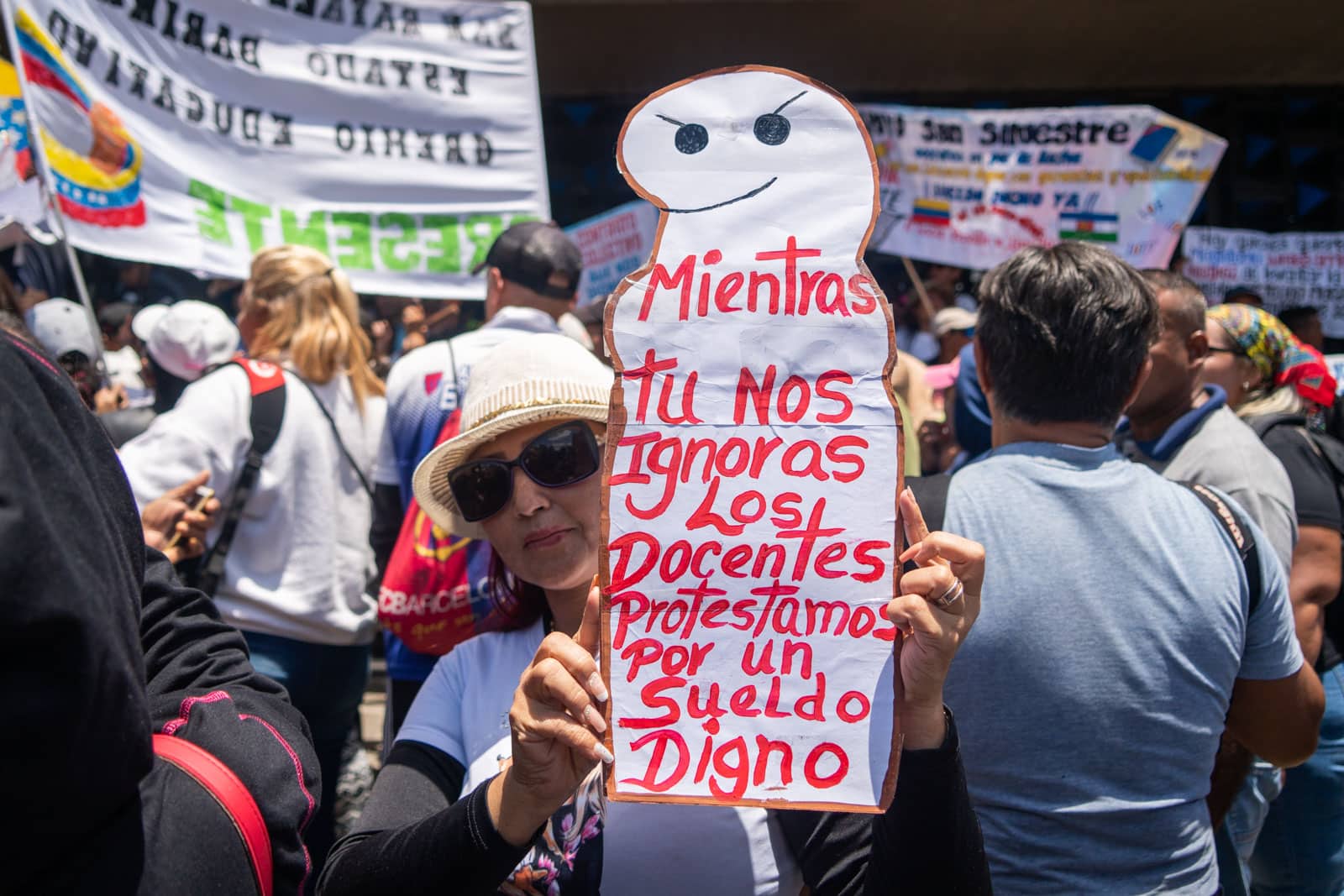

Con el surgimiento de la inteligencia artificial (IA), los ciberdelincuentes encontraron formas más sofisticadas de crear videos falsos con el fin de engañar a los usuarios en redes sociales o Internet en general.

A los videos, imágenes o archivos de audio generados con IA que buscan parecer auténticos para engañar a los usuarios se les conoce como deepfake, de acuerdo con un artículo publicado en el blog del LISA Institute, una institución académica especializada en ciberseguridad, criminología y geopolítica.

Las deepfakes comenzaron a cobrar importancia a partir del año 2017, cuando un usuario publicó en Reddit material pornográfico con el rostro de varias actrices famosas. Sin embargo, se descubrió que se trataba de archivos manipulados con inteligencia artificial.

El LISA Institute señala que existen dos tipos de deepfakes: las deepfaces, que se refieren al desarrollo de imágenes o videos falsos desde cero; y las deepvoices, que se refieren a la distorsión o manipulación de un audio.

¿Cómo identificar videos creados con IA?

Los expertos recomiendan seguir los siguientes pasos:

Fijarse en inconsistencias visuales

El equipo de Informática Forense de Colombia recomienda en su página web fijarse en los detalles de los videos difundidos en Internet, debido a que los deepfakes presentan inconsistencias visuales.

En este tipo de material creado con IA pueden aparecer artefactos extraños como distorsiones, píxeles fuera de lugar o líneas irregulares que no se explican fácilmente dentro del contexto del video, detallaron las autoridades en su página web.

Encontrar la fuente original

Uno de los consejos dados por los expertos es verificar la fuente de la información. Esto implica buscar si la cuenta que está difundiendo el video se trata de un vocero oficial o de un medio de comunicación reconocido.

En caso de existir alguna duda sobre el video publicado, lo recomendable es que los usuarios busquen otras fuentes de información confiables en Internet para corroborar o contrastar la información de un video.

Evaluar el fondo y las proporciones corporales

Expertos consultados por el diario peruano La República en diciembre de 2023 señalaron que los deepfakes presentan errores en algunos detalles de los cuerpos de las personas como sus manos, dientes y oídos.

También aconsejan a los usuarios detallar bien el fondo, ya que los videos creados con inteligencia artificial suelen mostrar elementos duplicados.

Desconfiar de videos con solicitudes de pago y descargas

Los ciberdelincuentes que crean estos videos falsos con inteligencia artificial muchas veces piden a los usuarios realizar algún tipo de descarga o pago, lo cual sirve para realizar estafas en línea, de acuerdo con una nota publicada en Infobae.

Lo recomendado por los expertos es verificar en una fuente oficial si este llamado a la acción lo realizaron las figuras públicas para descartar que no sea un ciberdelincuente haciéndose pasar por un famoso para estafar.

Una herramienta para identificar deepfakes

En mayo de 2023, la empresa estadounidense Intel anunció que estaba desarrollando una herramienta que serviría para identificar videos creados con inteligencia artificial. Sin embargo, no especificó a partir de cuándo estará disponible.

La compañía señaló que con esta herramienta, llamada FakeCatcher, buscan promover una inteligencia artificial “responsable” ante la proliferación de noticias falsas en Internet, detalló la agencia de noticias EuropaPress.

Asimismo, Intel indicó que esta herramienta se ejecutaría en un servidor y se manejaría a través de una plataforma basada en la web.

Para determinar si un video es falso, la herramienta analiza el flujo sanguíneo del orador en el video y ofrece resultados en milisegundos a los usuarios con una precisión del 96 %.